🧫Может Ли Наш Синтез V1 Обмануть Систему Биометрической Идентификации?

Какое-то время назад к нам обратился заказчик, и мы еще на V1 версии нашей системы синтеза голоса (не надо путать с более новой системой V3) сделали ему модель голоса его сотрудника для пен-теста коммерческой системы голосовой биометрической идентификации.

Тут важно сказать, что:

- Записано было около пары часов в микрофон (сейчас мы можем сделать синтез даже по 15 минутам речи);

- Обладатель голоса - не диктор, просто условно случайный сотрудник с яркими артефактами дикции (системный администратор);

- Микрофон был хорошим, но на фоне немного гудел кондиционер;

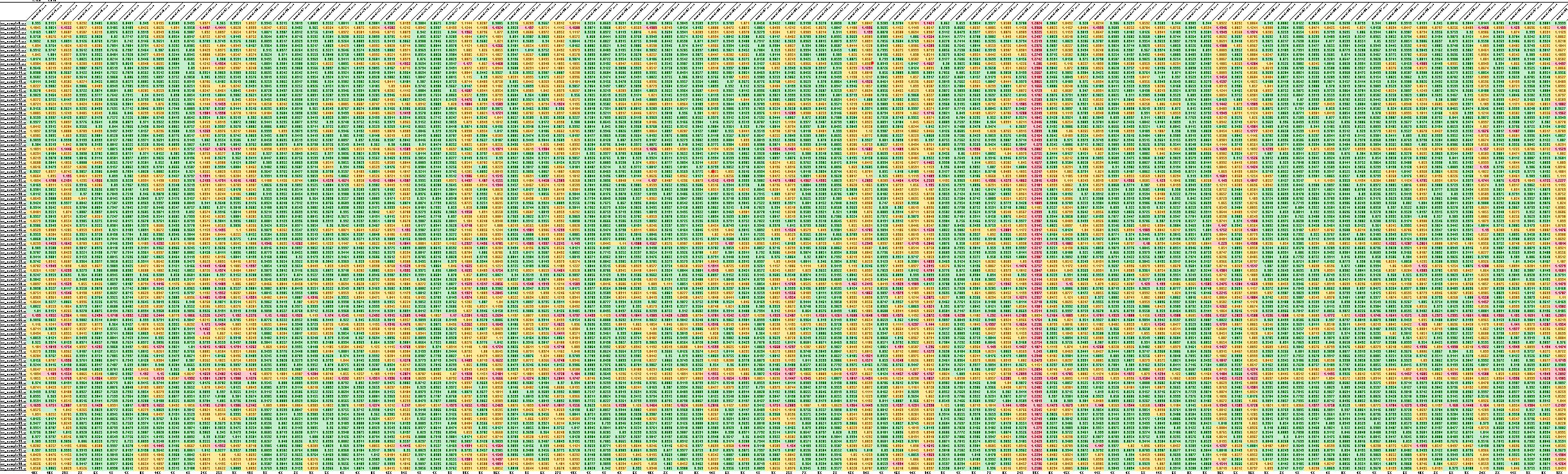

Описанная выше система голосовой биометрической идентификации выдает скор менее 1.1, если она считает, что в двух аудио-файлах говорит один и тот же человек, и скор более 1.1, если считает, что люди - разные.

100 реальных аудио человека сравниваются со 100 разными сгенерированными примерами (включая пример с таким же текстом), созданными на основе текстов этих же 100 реальных аудио.

На картинке ниже вы можете увидеть сравнение 100 реальных аудио со 100 сгенерированными аудио и скоры системы (помечено цветом). Зеленым цветом (скор менее 1) помечено, что система считает это одним человеком. Красным - это "разные" люди (скор более 1.1). Желтый - это пограничные значения (скор между 1 и 1.1).

Если взять среднее значение по точке отсечения 1.1, то получается, что в среднем НЕ УДАЛОСЬ обмануть систему где-то в 10% случаев. То есть в 90% случаев систему обмануть удалось.

По общей "матрице" также видно, что "плохие" (или "хорошие", тут как смотреть) примеры сгруппированы. По отзывам заказчика, основные ошибки относились скорее к недостаткам именно системы синтеза V1:

- Нестабильная работа;

- Нестабильность на более длинных аудио и на совсем коротких аудио;

- Система не принимала более 140 символов на вход;

Эти ошибки были поправлены с переходом на синтез V3 и в текущей версии синтеза в рамках 1 предложения определить синтез ли это уже практически невозможно (на абзаце текста - легко, по похожей интонации предложений).

Также люди в комментариях к статье на Хабре активно обсуждали, насколько "опасно" клонирование голоса в реальной жизни. Эта короткая заметка должна добавить одну точку к этим наблюдениям.

Но означает ли это, что всё, нужно бояться спуфинга вашим голосом? Конечно нет. Мы записывали аудио на качественный микрофон в относительной тишине. В реальности даже если мошенники будут так же подкованы (или будут таргетировать "важную" цель с помощью некоторых неадекватно дорогих и непрактичных публичных инструментов) - на их пути встанет низкое качество голосовых семплов, которые они скорее всего смогут получить "левыми" способами.